Data Center, el cerebro para las empresas

También conocidos como Centros de Procesamiento de Datos, podrían ser definidos como un espacio donde se albergan un gran número de servidores de alta gama, equipos de procesamiento y almacenamiento de datos, además de cuantiosos sistemas para conectar diversos dispositivos a la red, fuentes de alimentación; básicamente es hardware que consta de inimaginable y valiosa información.

Adicionalmente, estos centros también requieren del vital uso de las supercomputadoras. Sin embargo, ¿Qué las hace tan relevantes?, adicional a sus dimensiones físicas, poseen capacidades de cálculo a velocidades sorprendentes, su unidad de medida es el Teraflop, equivalente a billones de operaciones por segundo. A pesar de que tienen los componentes convencionales, sus partes internas están relacionadas entre sí para generar mayor rendimiento.

La Universidad Nacional Autónoma de México (UNAM) salvaguarda una de las supercomputadoras más destacables en América Latina, su nombre es “Miztli” y se ubica dentro de la Dirección General de Cómputo y Tecnologías de Información y Comunicación de la UNAM. Esta consta de “una capacidad de procesamiento de 118 TFlop/s (118 billones de operaciones aritméticas por segundo). Cuenta con 5,312 núcleos de procesamiento Intel E5-2670, 16 tarjetas NVIDIA m2090, una memoria RAM total de 15,000 Gbytes y un sistema de almacenamiento masivo de 750 Terabytes”.

Nos atrevemos a decir que el Data Center funge como el cerebro para un gran número de empresas. Procesa, controla y coordina cualquier movimiento de la información, por lo que son utilizados por importantes sectores económicos que definen nuestra vida cotidiana en actividades comerciales, de salud, entretenimiento, educación, de servicio público o simplemente el acceso a Internet y la telefonía que diariamente utilizamos.

Por todo esto, siempre deberán estar ligados a las medidas más extremas de seguridad y de protección a sus instalaciones, como lo es el aire acondicionado y una impecable y eficiente instalación de extinción de incendios que permita el funcionamiento del sistema con el menor daño posible.

La norma estandarizada mundial ANSI/TIA 942, tiene el objetivo de garantizar la calidad y el funcionamiento efectivo, en el cual hay diferentes niveles:

Tier 1: Sus componentes vitales como climatización o suministro eléctrico no son redundantes, y por ello, si fallan, se perdería capacidad en su operación.

Tier 2: En este caso, si son redundantes sus componentes vitales y están enfocados a la seguridad y resguardo de información con una fuente alternativa de energía y aire acondicionado.

Tier 3: De un alto nivel de tolerancia ante cualquier eventualidad y nunca interrumpe el servicio.

Tier 4: Está diseñado y montado para enfrentar situaciones críticas, se encuentra activo 99.9%, inclusive tienen instalaciones anti-bombas por el tipo de información que almacenan.

Hoy día es posible con gran certeza, conservar la continuidad del negocio, la eficiencia en los procesos e incrementar la productividad de una empresa gracias a la existencia de la nube y los centros de datos, por ello es trascendental el almacenamiento y los respaldos de la información de cada uno de los equipos de su empresa , ya sean fijos o móviles, no importando si ya tiene un servidor, siempre será muy ú el uso adicional de la nube.

La evolución de los Centros de Datos

Siguiendo la inercia natural de la evolución, los centros de datos se han desarrollado en el tiempo con la intención de responder a las necesidades de información que se han ido presentando, por lo que su dimensión hoy, depende del volumen de información que se pretende utilizar y procesar.En comparación con décadas pasadas, en la actualidad se invierten millones de dólares en una infraestructura sofisticada que garantiza el funcionamiento de los equipos y el servicio al 100 por ciento y durante las 24 horas del día.

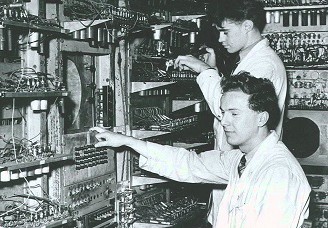

Hace 60 años no existían sistemas de enfriamiento, el calor que se concentraba era una problemática para los ingenieros de la época y en aquel entonces una sola computadora conformaba un Data Center, por ejemplo, la Manchester Small-Scale Experimental Machine (1948) pesaba casi una tonelada y medía 5.16 por 2.13 metros, lo que nos muestra la magnitud necesaria en esa época para almacenar y procesar información.

Entre otros elementos que han cambiado, están las tecnologías de conectividad como la implementación de la fibra óptica que favorece la transmisión de datos a miles de kilómetros de distancia y con inmunidad a las interferencias electromagnéticas.

Actualmente se han desarrollado los Data Centers Modulares, que a diferencia de los tradicionales, pueden ser trasladados a otra ubicación en la cual haya necesidad de procesar información.